DeepSeek V4 的真正冲击不在于它是又一个高性能开源模型,而在于它同时验证了三件事:最宽松的开源许可证、非英伟达硬件上的前沿训练、以及让西方 API 定价显得来自另一个时代的成本结构。2026 年 4 月 24 日,这三个条件同时满足123。

模型发布当天,权重即上架 HuggingFace,许可证为 MIT——比 Llama 的 Apache 2.0 更宽松1。训练与推理完全运行在华为 Ascend 950PR 芯片上,英伟达和 AMD 未获得预发布优化权限2。API 定价从 Flash 的 $0.14/百万输入 token 起步,Pro 版本输出价 $3.48,约为 GPT-5.5 Pro 的 1/8.63。

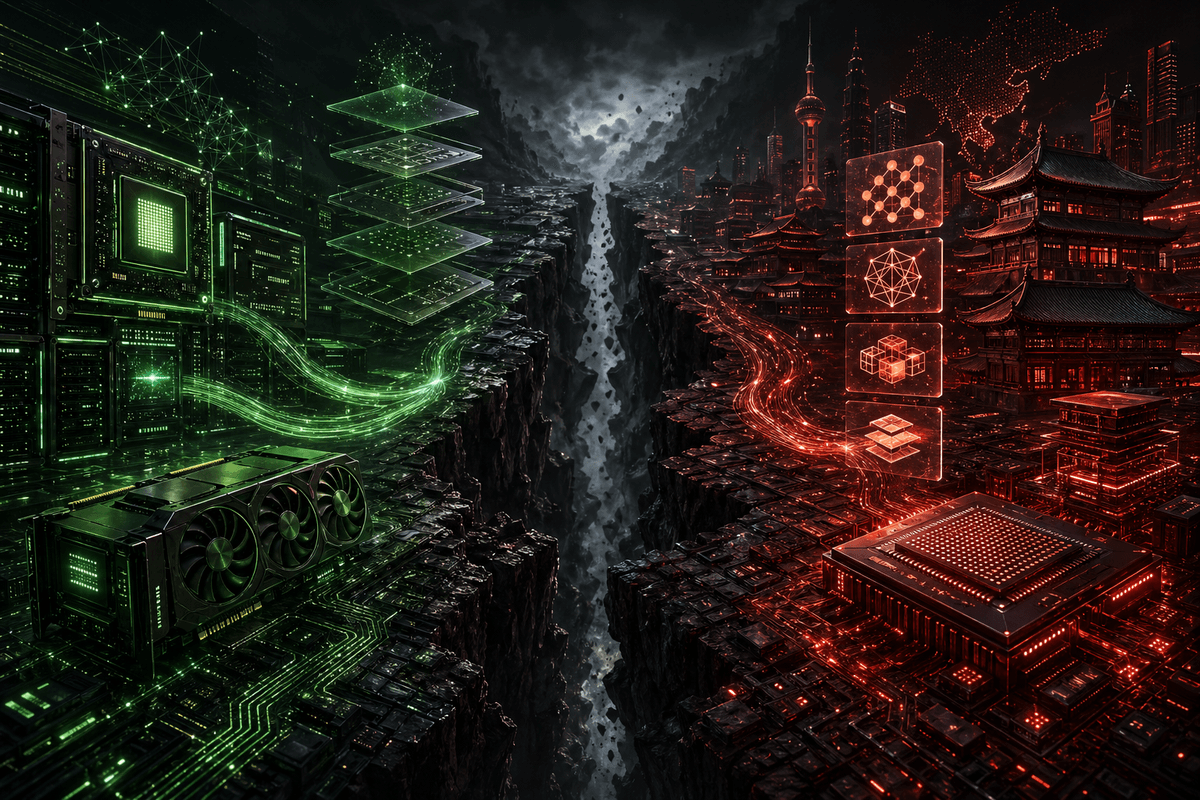

这不是一次普通的技术发布。这是全球 AI 基础设施 stack 开始分裂的一个数据点。

首日 MIT 开源:许可证即战略

V4 发布当天在 HuggingFace 上提供了四个 checkpoint1:

| 模型 | 总参数 | 激活参数 | 上下文 | 精度 |

|---|---|---|---|---|

| V4-Pro-Base | 1.6T | 49B | 1M | FP8 Mixed |

| V4-Pro (Instruct) | 1.6T | 49B | 1M | FP4 + FP8 |

| V4-Flash-Base | 284B | 13B | 1M | FP8 Mixed |

| V4-Flash (Instruct) | 284B | 13B | 1M | FP4 + FP8 |

许可证是 MIT——比 Meta 的 Llama 或 Mistral 的 Apache 2.0 更宽松1。开发者可以下载权重、用自有数据微调、商业部署,无需通知 DeepSeek。没有使用限制,没有版权费。

下载大小说明部署门槛:Flash 约 160GB,量化后可在 128GB Mac Studio 上运行;Pro 约 865GB,需要 GPU 集群但可通过 API 使用4。

| 模型 | 输入 ($/M token) | 输出 ($/M token) |

|---|---|---|

| DeepSeek V4-Flash | $0.14 | $0.28 |

| DeepSeek V4-Pro | $1.74 | $3.48 |

| GPT-5.5 Pro | $15.00 | $30.00 |

| Claude Opus 4.7 | $15.00 | $75.00 |

V4-Pro 输出价格约为 GPT-5.5 Pro 的 1/8.6;V4-Flash 约 1/1073。发布首周 DeepSeek 还给了 V4-Pro 一个 75% 折扣(输入 $0.44、输出 $0.87,持续到 5 月 5 日),同时把 API 缓存命中价格降到原来的 1/106。

这个定价策略的意图很明确:在开发者做技术选型的窗口期,用不可拒绝的价格锚定使用习惯。一旦工作流跑通、集成成本沉没,即使折扣结束,迁移回高价 API 的动力也会大幅下降。这不是在卖模型,这是在买生态份额。

和国内其他实验室的对比

开源节奏即竞争策略

DeepSeek 的首日 MIT 开源,和其他中国模型的发布节奏形成了对比:

MiniMax M2.7 的 API 在 3 月 18 日上线,但权重直到 4 月 12 日才放出——隔了 25 天7。更糟的是,许可证明确写着非商用:非商业用途可以按 MIT 风格使用,但商业部署需要 MiniMax 的书面授权7。MiniMax 之前的模型(M2、M2.5)是 MIT 或 Modified-MIT,M2.7 反而退步了。HuggingFace 讨论区发售后几天内就积累了几百条批评7。

GLM-5.1 来自智谱(Z.ai),API 在 3 月 27 日上线,权重在 4 月 7 日开源——隔了 11 天8。许可证是 MIT,这点没问题。但这 11 天的空档很关键:开发者在评估模型时只能用 API,没法自托管。GLM-5 也有类似的节奏——2 月 11 日上线 API,约两周后才放权重8。

开源权重发布时间对比

| 模型 | API 上线 | 权重发布 | 延迟 | 许可证 |

|---|---|---|---|---|

| DeepSeek V4 | 4 月 24 日 | 4 月 24 日 | 0 天 | MIT |

| GLM-5.1 | 3 月 27 日 | 4 月 7 日 | 11 天 | MIT |

| MiniMax M2.7 | 3 月 18 日 | 4 月 12 日 | 25 天 | 非商用 |

首日开源不是姿态,是战略。在 AI 基础设施竞争进入白热化的阶段,“API 可用”与”权重可下载”之间的时间差,就是平台锁定的窗口期。DeepSeek 把这个窗口压缩到零——不给犹豫期,不给锁定机会。

对比之下,延迟开源的代价是真实的:GLM-5.1 的 11 天空档里,评估者只能用 API 测试;MiniMax M2.7 的 25 天延迟加上非商用限制,直接引发 HuggingFace 社区数百条批评7。DeepSeek 选择了一种更激进的路径:用许可证的宽松度换取生态采纳速度。这不是利他主义——这是在开源模型供给过剩的市场中,争夺开发者注意力和部署习惯的最有效手段。

硬件脱钩:从实验到出货

DeepSeek V4 完全运行在华为 Ascend 950PR 芯片上——训练和推理皆是2。这间实验室拒绝了英伟达和 AMD 的预发布优化请求,转而给华为和寒武纪数周的提前访问权9。

这不是首次尝试。2025 年初,DeepSeek 曾尝试用 Ascend 910C 训练推理模型 R2,结果反复失败:芯片间通信延迟导致同步崩溃、内存一致性错误损坏训练进度10。最终退回英伟达 GPU,华为硬件仅用于推理10。

V4 是第二次尝试。这次成功了。区别不在于硬件迭代了多少,而在于 DeepSeek 证明了:在现有出口管制条件下,非英伟达硬件已经足以支撑前沿模型的完整生命周期。

| 指标 | Ascend 950PR | NVIDIA H20 | NVIDIA H100 | NVIDIA B200 |

|---|---|---|---|---|

| 性能对比 | 2.8× H20 | 基准 | — | — |

| vs H100 推理 | ~60% | — | 基准 | >2× H100 |

| 单价 | ~$6,900 | 出口受限 | $25,000+ | $30,000+ |

| 2026 年计划产量 | 75 万片 | 出口受限 | — | — |

Ascend 950PR 约达 H100 推理性能的 60%11。这不是平起平坐,但可行——尤其结合 V4 每 token 只激活 3% 参数的稀疏架构。

软件栈是华为的 CANN(Compute Architecture for Neural Networks),CUDA 的替代品。CANN 的成熟度差距是真实的:R2 的训练失败根源是 CANN 的分布式训练不足,而非硬件缺陷10。V4 的成功表明差距在 2025 年初到 2026 年初间缩小了。结果:一个从头到尾不用英伟达的前沿模型。

架构:为规模买单的效率

V4 保留了 V3 的 DeepSeekMoE 框架,但做了三项结构性改变1:

1. 混合注意力(CSA + HCA)

V4 用两种交替机制替换了标准注意力:

- CSA(压缩稀疏注意力):压缩 KV 缓存,每个查询只关注 top-k 压缩条目,提供局部细节

- HCA(高度压缩注意力):128 倍压缩率,在压缩表示上执行密集注意力,提供全局概览

CSA 和 HCA 在网络中交替排列。在 1M token 上下文下,V4-Pro 只需要 V3.2 单 token 推理 FLOPs 的 27%,KV 缓存的 10%1。这不是四舍五入的误差——是结构性的效率提升。

2. Muon 优化器

V4 将大部分参数从 AdamW 切换到 Muon,报告收敛更快、万亿参数训练更稳定1。AdamW 仅保留给 embedding、预测头和 RMSNorm 权重。峰值学习率 2.0e-4,cosine decay。

3. 流形约束超连接(mHC)

标准残差连接被 mHC 取代,它将残差信号投影到流形上以稳定极深网络中的信号传播1。

V4 vs. V3.2 在 1M token 上下文1:

| 指标 | V3.2 | V4-Pro | 改善 |

|---|---|---|---|

| 单 token 推理 FLOPs | 100% | 27% | 降低 73% |

| KV 缓存内存 | 100% | 10% | 降低 90% |

| 总参数 | 671B | 1.6T | 2.4 倍 |

| 激活参数 | 37B | 49B | 1.3 倍 |

反直觉的结果:V4 大了 2.4 倍,但在满上下文下每 token 计算量反而减少了 73%。这个效率曲线意味着什么?它意味着 DeepSeek 可以在性能较弱的硬件上(Ascend 950PR 约为 H100 的 60%)运行一个规模更大的模型,而实际推理成本低于在英伟达硬件上运行一个更小的模型。架构效率不是在实验室里自我欣赏的指标——它是硬件脱钩的前提条件。没有这 73% 的 FLOPs 削减,Ascend 950PR 撑不起 1.6T 参数模型的生产部署。

对英伟达意味着什么

股价反应:市场读到了什么

V4 发布当天,英伟达股价下跌 1.41%12。这个数字本身不大,但同期中国芯片股暴涨——中芯国际港股上涨 9.4%,华虹半导体上涨 13%+13——说明市场读出的是一个更具体的信号:非美芯片供应链开始具备商业价值,而不仅仅是 DeepSeek 对英伟达的竞争威胁。

一个经常被引用的数字:如果出口管制取消,中国企业今年会购买约 150 万块 H200,约 $300 亿潜在收入12。但这个假设本身就在弱化——出口管制没有取消的迹象,而中国 AI 基础设施市场年规模已达 $500 亿,年增长 50%12。这笔钱不会消失,只会流向别处。

黄仁勋的担忧:不是销量,是轨迹

英伟达 CEO 黄仁勋在 V4 发布前警告:如果 DeepSeek 针对华为芯片而非美国硬件优化,对美国将是”horrible outcome”14。这个判断的底层逻辑不在于华为当下的产能——2026 年 Ascend 总算力仅相当于英伟达的 3-5%14——而在于技术栈迁移的路径依赖。

路径依赖的核心是:每次有像 V4 这样的前沿模型在 Ascend 上出货,下一个中国实验室的迁移成本就降低一次。每次 CANN 改进,从 CUDA 切换的学习曲线就平滑一点。字节和阿里在 2026 年 1 月拿到 950PR 样片,已经在生产环境跑了两个月的基准测试15。这不是实验室好奇,是大规模部署前的验证。

英伟达的防御:速度 vs. 成本

英伟达在 V4 发布当天推出 Day-0 Blackwell 支持,声称在 Blackwell GPU 上用 NVFP4 每秒可处理 3,500 token16。技术层面的潜台词是:“你可以在华为上跑,但在我这更快。”

但价格表提供了另一套逻辑。对 Flash 级别的工作负载,英伟达方案贵 35 倍。在推理成本占 AI 运营支出大头的生产环境中,“更快”只有在延迟敏感场景下才值得支付溢价。对于大多数批处理、内容生成和后台推理任务,Ascend 的性能已经够用——而够用就是竞争。

生态分叉:比芯片更深层的问题

真正的问题不是英伟达少卖了多少张卡。400 万+ 开发者建立在 CUDA 上,模型、框架、内核、部署管线都默认英伟达硬件17。这是一个数十亿美元和数千万人年积累出来的生态护城河。

V4 的意义在于:它证明了这个护城河可以被绕过。如果中国实验室持续在 Ascend + CANN + MindSpore + MindIE 这条线上出货前沿模型,全球 AI 基础设施就会分裂为两个并行生态。西方公司留在 CUDA。中国公司建在 CANN 上。每次分叉加深,重新汇合的成本就增加一分。

V4 不证明分叉不可逆转。但它证明分叉已经发生。

分裂的起点

DeepSeek V4 不会杀死英伟达,这几乎不需要论证。Ascend 950PR 与 Blackwell 之间的性能差距是真实的,CANN 与 CUDA 之间的生态成熟度鸿沟需要多年才能填平——如果能被填平的话。全球绝大多数 AI 训练和推理工作负载仍运行在英伟达硬件上,这一事实短期内不会改变。

但 V4 改变了问题的性质。在此之前,“非美 AI 栈是否可行”是一个理论问题。V4 之后,它变成了一个产品问题:在哪些场景下够用,在哪些场景下不够好,以及不够好之间的差距是缩小还是扩大。

一个从头不用英伟达的前沿模型,使用最宽松的开源许可证,定价让西方 API 看起来像上一个周期的产物——这三件事同时发生,意味着完整的非美 AI 技术栈已经从一个研究概念变成了可用的商业产品。这个栈的效率和成熟度能否在 2027 或 2028 年追平美国栈,取决于 CANN 的迭代速度和中国芯片产能的爬坡节奏。

但更深层的问题是:即使性能差距长期存在,全球 AI 市场是否足以支撑两个并行生态?历史经验——从 x86 vs. ARM 到 iOS vs. Android——表明,技术差异可以长期共存,但前提是市场空间足够大。AI 基础设施市场的规模显然足够。这意味着 V4 标记的分叉并非暂时偏离;它指向结构性重组的开始。

值得持续跟踪的变量,是其他中国实验室的跟进速度,而非 DeepSeek 的下一款模型。当字节、阿里、智谱的旗舰模型也运行在 Ascend 上时,分叉就从个案变成趋势。那个转折点,可能比 V4 本身更值得注意。

参考资料

Footnotes

-

DeepSeek-V4 技术报告 — 架构细节、CSA/HCA 注意力、Muon 优化器、mHC 连接、基准测试结果:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/resolve/main/DeepSeek_V4.pdf ↩ ↩2 ↩3 ↩4 ↩5 ↩6 ↩7 ↩8 ↩9

-

The Information — DeepSeek 拒绝向英伟达/AMD 提供 V4 预发布优化权限,给华为提前访问:https://www.theinformation.com/ ↩ ↩2 ↩3 ↩4

-

Context Studios — “DeepSeek V4: The Open Source Pricing Earthquake”,定价分析 vs GPT-5.5 Pro 和 Claude Opus 4.7:https://www.contextstudios.ai/blog/deepseek-v4-the-open-source-pricing-earthquake ↩ ↩2 ↩3 ↩4

-

HuggingFace DeepSeek V4 博客 — checkpoint 大小、部署指南:https://huggingface.co/blog/deepseekv4 ↩

-

DeepSeek API 文档 — 官方定价,V4 预览发布:https://api-docs.deepseek.com/news/news260424 ↩

-

Reuters — DeepSeek 首周 75% 折扣,缓存命中价格降至 1/10:https://www.reuters.com/world/china/chinas-deepseek-slashes-prices-new-ai-model-2026-04-27/ ↩

-

MiniMax M2.7 许可证 — 非商业许可证,权重比 API 晚 25 天发布,HuggingFace 社区强烈反弹:https://github.com/MiniMax-AI/MiniMax-M2.7/blob/main/LICENSE ;发布时间线:https://serenitiesai.com/articles/minimax-m2-7-open-source-self-evolving-benchmarks-pricing-2026 ↩ ↩2 ↩3 ↩4

-

GLM-5.1 发布时间线 — API 3 月 27 日,权重 4 月 7 日(延迟 11 天),MIT 许可证:https://z.ai/blog/glm-5.1 ↩ ↩2

-

Reuters — “DeepSeek withholds latest AI model from US chipmakers including NVIDIA”,2026 年 2 月 25 日:https://www.reuters.com/world/china/deepseek-withholds-latest-ai-model-us-chipmakers-including-nvidia-sources-say-2026-02-25/ ↩

-

My Written Word — R2 在 Ascend 910C 上的训练失败、软件栈成熟度问题:https://mywrittenword.com/2026/04/05/deepseek-v4-huawei-ascend-chips-moe-architecture-export-controls-2026/ ↩ ↩2 ↩3

-

Tom’s Hardware — Ascend 910C 测试报告:约 60% H100 推理性能:https://www.tomshardware.com/ ↩ ↩2

-

Parameter.io — 英伟达股价影响,中国 AI 市场 $500 亿数据:https://parameter.io/nvidia-nvda-stock-dips-as-deepseek-v4-opts-for-huawei-over-american-chips/ ↩ ↩2 ↩3

-

Yahoo Finance — V4 发布推动中国芯片股上涨:中芯国际 +9.4%,华虹 +13%:https://finance.yahoo.com/sectors/technology/articles/deepseek-unveils-v4-models-lifts-164531615.html ↩

-

The Next Web — 黄仁勋在 Dwarkesh Podcast 警告 “horrible outcome”:https://thenextweb.com/news/nvidia-huang-deepseek-huawei-chips-horrible-outcome ↩ ↩2

-

Neural Network World — 字节/阿里 950PR 样片测试,75 万片产量计划,生态分叉分析:https://neuralnetworkworld.com/deepseek-v4-to-run-on-huawei-chips-sidelining-nvidia/ ↩

-

NVIDIA Developer Blog — Day-0 Blackwell 支持,V4 上 3,500 tokens/sec:https://developer.nvidia.com/blog/build-with-deepseek-v4-using-nvidia-blackwell-and-gpu-accelerated-endpoints/ ↩

-

Pulse Mark — CUDA 生态依赖,CANN 替代方案,生态分叉风险分析:https://pulsemark.ai/deepseek-v4-release-multimodal-huawei-cuda/ ↩