DeepSeek V4の真の衝撃は、またひとつ高性能なオープンソースモデルが登場したことではない。最も寛容なオープンソースライセンス、非NVIDIAハードウェアでの最先端トレーニング、そして欧米のAPI価格を過去の時代の産物に見せるコスト構造——この3つを同時に実証したことだ。2026年4月24日、これら3つの条件が同時に満たされた123。

モデルは即日HuggingFaceに公開され、ライセンスはMIT——LlamaのApache 2.0よりも寛容1。トレーニングと推論は完全に華為Ascend 950PRチップ上で実行され、NVIDIAとAMDにはプレリリース最適化のアクセス権が与えられなかった2。API価格はFlashの入力100万トークンあたり$0.14から、Proバージョンの出力価格は$3.48で、GPT-5.5 Proの約1/8.63。

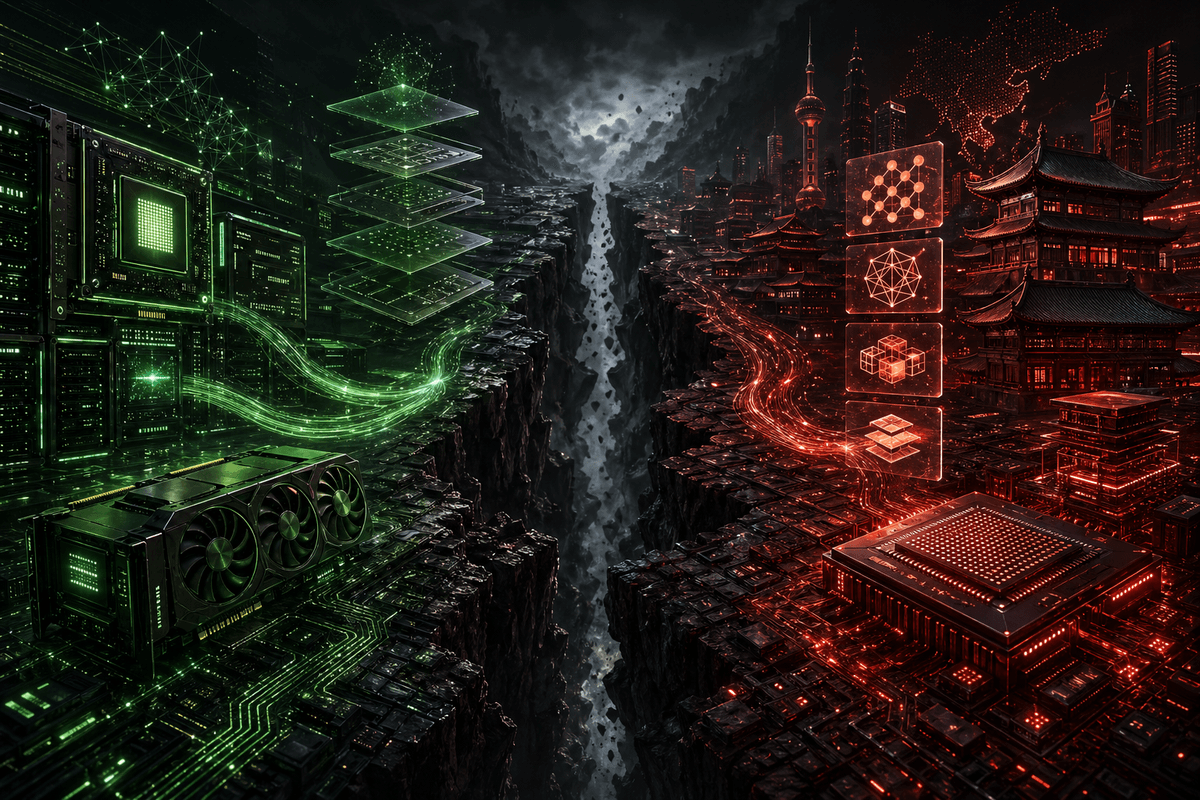

これは通常の技術リリースではない。これは、グローバルAIインフラストラクチャースタックが分裂し始めていることを示すデータポイントだ。

初日オープンソース:ライセンスは戦略である

V4は発売日に4つのチェックポイントをHuggingFaceで公開した1:

| モデル | 総パラメータ | アクティブ | コンテキスト | 精度 |

|---|---|---|---|---|

| V4-Pro-Base | 1.6T | 49B | 1M | FP8 Mixed |

| V4-Pro (Instruct) | 1.6T | 49B | 1M | FP4 + FP8 |

| V4-Flash-Base | 284B | 13B | 1M | FP8 Mixed |

| V4-Flash (Instruct) | 284B | 13B | 1M | FP4 + FP8 |

ライセンスはMIT——MetaのLlamaやMistralのApache 2.0よりも緩やかだ1。開発者は重みをダウンロードし、独自データでファインチューニングし、DeepSeekに通知せず商用展開できる。使用制限なし、ロイヤリティ義務なし。

ダウンロードサイズが示す展開の実態:Flashは約160GBで量子化すれば128GB Mac Studioでも動作可能。Proは約865GBでGPUクラスターが必要だがAPI経由で利用できる4。

| モデル | 入力 ($/M トークン) | 出力 ($/M トークン) |

|---|---|---|

| DeepSeek V4-Flash | $0.14 | $0.28 |

| DeepSeek V4-Pro | $1.74 | $3.48 |

| GPT-5.5 Pro | $15.00 | $30.00 |

| Claude Opus 4.7 | $15.00 | $75.00 |

V4-Proの出力価格はGPT-5.5 Proの約1/8.6、V4-Flashは約1/1073。さらにDeepSeekはV4-Proに初週75%割引をかけ(入力$0.44/出力$0.87、5月5日まで)、全APIのキャッシュヒット価格も1/10に引き下げた6。

この価格戦略の意図は明白だ:開発者が技術選定を行う窓口期間に、断りがたい価格で使用習慣を固定する。一度ワークフローが構築され、統合コストが埋没すれば、割引終了後も高額APIに戻る動機は大きく低下する。これはモデルを売っているのではない——エコシステムのシェアを買っているのだ。

他の中国ラボとの比較

DeepSeekの初日MITリリースは、他の中国モデルのリリースパターンと際立った対比をなす:

MiniMax M2.7のAPIは3月18日に開始したが、重みの公開は4月12日まで遅れた——25日後だ7。さらに悪いことに、ライセンスは非商用と明記されている:非商用利用はMITスタイルで許可、商用展開にはMiniMaxの書面による許可が必要7。MiniMaxの以前のモデル(M2、M2.5)はMITまたはModified-MITだったが、M2.7は明らかな後退だ。HuggingFaceのディスカッションスレッドには数日で数百件の批判が殺到した7。

GLM-5.1はZ.ai(智譜)が3月27日にAPIを開始し、4月7日に重みを公開した——約11日後だ8。ライセンスはMITで問題ない。だがこの11日間の遅れは重要だ:開発者はモデルを評価する際、APIに依存せざるを得ず、自前でホストする選択肢がなかった。GLM-5も同様のパターンで、2月11日のAPIから約2週間後に重みが公開された8。

オープンウェイト公開の比較

| モデル | API開始 | 重み公開 | 遅延 | ライセンス |

|---|---|---|---|---|

| DeepSeek V4 | 4月24日 | 4月24日 | 0日 | MIT |

| GLM-5.1 | 3月27日 | 4月7日 | 11日 | MIT |

| MiniMax M2.7 | 3月18日 | 4月12日 | 25日 | 非商用 |

初日オープンソースは態度ではない——戦略だ。AIインフラ競争においてスイッチングコストがAPI呼び出しごとに蓄積される中、「API利用可能」と「重みダウンロード可能」の間の時間差こそが、プラットフォームロックインの窓口である。DeepSeekはその窓口をゼロに圧縮した——猶予期間なし、ロックインの機会なし。

遅延のコストは現実のものだ:GLM-5.1の11日間の空白は、評価者をAPIのみのテストに制限した。MiniMax M2.7の25日間の遅延と非商用ライセンスの組み合わせは、HuggingFaceで数百件の批判コメントを引き起こした7。DeepSeekはより攻撃的な道を選んだ:ライセンスの寛容さをエコシステム採用速度と交換する。これは利他主義ではない——供給過剰なオープンソースモデル市場において、開発者の注意と展開習慣を争奪する最も効率的な手段だ。

ハードウェア脱却:実験から出荷へ

DeepSeek V4は完全に華為ハードウェア上で動作する:Ascend 950PRチップをトレーニングと推論の両方に使用2。ラボはNVIDIAとAMDのプレリリース最適化アクセスを拒否し、華為とCambriconに数週間の先行アクセスを与えた9。

これは初めての試みではない。2025年初頭、DeepSeekは推論モデルR2のトレーニングをAscend 910Cで試みた。それらのトレーニングは繰り返し失敗した:チップ間通信遅延が同期失敗を引き起こし、メモリ一貫性エラーがトレーニング進行を破壊した10。DeepSeekはR2のAscendトレーニングを断念し、NVIDIA GPUに戻り、華為ハードウェアを推論専用に格下げした10。

V4は2回目の試みだ。成功した。違いはハードウェアの反復回数ではない——DeepSeekは、既存の輸出規制の下で、非NVIDIAハードウェアが最先端モデルの全ライフサイクルを支えられることを証明したのだ。

Ascend 950PR vs. NVIDIAハードウェア211:

| 指標 | Ascend 950PR | NVIDIA H20 | NVIDIA H100 | NVIDIA B200 |

|---|---|---|---|---|

| 性能(相対) | H20の2.8倍 | ベースライン | — | — |

| H100推論比 | ~60% | — | ベースライン | H100の2倍超 |

| 単価 | ~$6,900 | 輸出制限 | $25,000+ | $30,000+ |

| 2026年生産計画 | 75万枚 | 輸出制限 | — | — |

Ascend 950PRはH100推論性能の約60%11。同等ではないが、実行可能だ——特にV4のトークンあたり3%しかパラメータをアクティブ化しない疎アーキテクチャと組み合わせれば。

ソフトウェアスタックは華為のCANN(Compute Architecture for Neural Networks)、CUDAの代替品。CANNの成熟度ギャップは現実だ:R2のトレーニング失敗の根源はCANNの分散トレーニングの限界であり、ハードウェア欠陥ではなかった10。V4の成功は、2025年初頭から2026年初頭の間にギャップが縮まったことを示唆する。結果:NVIDIAを使わずにトレーニングから推論まで完結したフロンティアモデルができた。

アーキテクチャ:効率性がハードウェアギャップを埋めた

V4はV3のDeepSeekMoEフレームワークを維持しつつ、設計の最適化によって計算効率を大幅に改善した1。

意外なことに、V4は2.4倍に巨大化したのに、トークンあたりの計算量は73%減っている。この効率性は学術的な好奇心ではない——ハードウェア脱却の前提条件だ。73%のFLOPs削減がなければ、Ascend 950PR(H100推論性能の約60%)では1.6Tパラメータモデルの本番展開は不可能だった。アーキテクチャがハードウェアギャップの代金を支払ったのだ。

NVIDIAにとって何を意味するか

株価と市場反応

V4リリース当日、NVIDIA株は1.41%下落12。一方、中国チップ株は急騰:SMICは香港取引で9.4%上昇、華虹半導体は13%+上昇13。

輸出規制が明日解除されれば、中国企業は今年約150万枚のH200を購入するだろう——約$300億12。中国のAIインフラ市場は年間$500億、年率50%成長12。

Jensen Huangの警告

NVIDIA CEO Jensen HuangはV4リリース前のDwarkesh Podcastで、DeepSeekが華為チップ向けに最適化することは米国にとって「horrible outcome」だと警告した14。

彼が心配しているのは今日ではない。華為の2026年のAIチップ生産量は、NVIDIAの総計算能力の3〜5%にすぎない14。Ascend 950PRは特定のMLPerfワークロードでH100相当の約89%のスループットを40%低い消費電力で達成するが15、大規模分散トレーニングではかなり劣る。

懸念は軌道だ。V4のようなモデルがAscendで動くたびに、次に試す中国のラボのハードルは下がる。CANNが改善されるたびに、CUDAから乗り換えるコストは縮む。ByteDanceとAlibabaは2026年1月に950PRのサンプルをもらい、もう2ヶ月間本番環境でベンチマークを回している16。

NVIDIAの対応:Day-0 Blackwell

NVIDIAはV4リリース当日にDay-0 Blackwellサポートを開始し、Blackwell GPU上でNVFP4を使用して1.6Tモデルで毎秒3,500トークンと主張17。メッセージは:「華為でも動くが、こちらの方が速い。」

反論は上記の価格表にある。「速い」はFlashレベルのワークロードでは35倍のコスト。ほとんどの本番ユースケースでは、そのトレードオフに見合わない。

真のリスク:エコシステムフォーク

より深い問題はチップ販売ではない——ソフトウェア依存だ。400万+の開発者がCUDA上に構築している。モデル、フレームワーク、カーネル、展開パイプラインはNVIDIAハードウェアを前提としている18。

中国のラボが並行スタック——Ascend + CANN + MindSpore + MindIE——を構築し、ほとんどの本番用途で十分に機能すれば、グローバルAIインフラは2つのエコシステムに分裂する。欧米企業はCUDAに留まる。中国企業はCANN上に構築する。分裂は恒久的になる。

V4はこれが起こることを証明しない。しかし、起こりうることを証明する。

分裂の起点

DeepSeek V4はNVIDIAを殺さない——これはほとんど議論の余地がない。Ascend 950PRとBlackwellの性能差は現実であり、CANNとCUDAのエコシステム成熟度の格差は縮まるのに何年もかかる——縮まるとすればの話だが。世界のAIトレーニングと推論ワークロードの大半は依然としてNVIDIAハードウェア上で稼働しており、これは当面変わらない。

しかしV4は問いの性質を変えた。これまで「非米AIスタックは機能するか」は理論上の問いだった。V4以降、それは製品レベルの問いになった:どのユースケースで十分か、どのユースケースで不十分か、そしてその差は拡大しているのか縮小しているのか。

NVIDIAを一切使わないフロンティアモデル、最も寛容なオープンソースライセンス、欧米のAPI価格を過去のサイクルの遺物に見せる価格設定——この3つが同時に成立したことは、完全な非米AI技術スタックが研究コンセプトではなく、稼働する商用製品であることを意味する。このスタックの効率性と成熟度が2027年か2028年までに米国スタックに追いつくかどうかは、CANNの反復速度と中国チップ生産能力の立ち上がり曲線にかかっている。

しかし、より深い問いはこれだ:たとえ性能格差が長期的に残るとしても、グローバルAI市場は2つの並行エコシステムを支えるに十分な規模か。x86対ARMからiOS対Androidに至る歴史的先例は、市場が十分に大きければ技術的分岐は無期限に存続できることを示している。AIインフラ市場の規模は明らかに十分だ。つまり、V4が刻んだ分岐点は、一時的な逸脱ではなく、構造的再編の始まりかもしれない。

観察すべき変数はDeepSeekの次のモデルではない。他の中国ラボの追随速度だ。ByteDance、Alibaba、智譜のフラッグシップモデルがAscend上で稼働し始めたとき、分岐は一事例からトレンドに変わる。その変曲点こそ、V4そのものよりも注目に値するかもしれない。

参考文献

Footnotes

-

DeepSeek-V4技術報告書 — アーキテクチャ詳細、CSA/HCAアテンション、Muonオプティマイザー、mHC接続:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/resolve/main/DeepSeek_V4.pdf ↩ ↩2 ↩3 ↩4 ↩5

-

The Information — DeepSeekがNVIDIA/AMDへのV4プレリリース最適化提供を拒否:https://www.theinformation.com/ ↩ ↩2 ↩3 ↩4

-

Context Studios — “DeepSeek V4: The Open Source Pricing Earthquake”:https://www.contextstudios.ai/blog/deepseek-v4-the-open-source-pricing-earthquake ↩ ↩2 ↩3 ↩4

-

HuggingFace DeepSeek V4ブログ — チェックポイントサイズ、展開ガイダンス:https://huggingface.co/blog/deepseekv4 ↩

-

DeepSeek APIドキュメント — 公式価格:https://api-docs.deepseek.com/news/news260424 ↩

-

Reuters — DeepSeek初週75%割引、キャッシュヒット価格を1/10に:https://www.reuters.com/world/china/chinas-deepseek-slashes-prices-new-ai-model-2026-04-27/ ↩

-

MiniMax M2.7ライセンス — 非商用ライセンス、APIから25日後に重み公開:https://github.com/MiniMax-AI/MiniMax-M2.7/blob/main/LICENSE ;リリースタイムライン:https://serenitiesai.com/articles/minimax-m2-7-open-source-self-evolving-benchmarks-pricing-2026 ↩ ↩2 ↩3 ↩4

-

GLM-5.1リリースタイムライン — API 3月27日、重み4月7日(11日遅延)、MITライセンス:https://z.ai/blog/glm-5.1 ↩ ↩2

-

Reuters — “DeepSeek withholds latest AI model from US chipmakers”, 2026年2月25日:https://www.reuters.com/world/china/deepseek-withholds-latest-ai-model-us-chipmakers-including-nvidia-sources-say-2026-02-25/ ↩

-

My Written Word — Ascend 910C上でのR2訓練失敗:https://mywrittenword.com/2026/04/05/deepseek-v4-huawei-ascend-chips-moe-architecture-export-controls-2026/ ↩ ↩2 ↩3

-

Tom’s Hardware — Ascend 910Cテスト:H100推論性能の約60%:https://www.tomshardware.com/ ↩ ↩2

-

Parameter.io — NVIDIA株価への影響:https://parameter.io/nvidia-nvda-stock-dips-as-deepseek-v4-opts-for-huawei-over-american-chips/ ↩ ↩2 ↩3

-

Yahoo Finance — 中国チップ株上昇:https://finance.yahoo.com/sectors/technology/articles/deepseek-unveils-v4-models-lifts-164531615.html ↩

-

The Next Web — Jensen Huangが警告:https://thenextweb.com/news/nvidia-huang-deepseek-huawei-chips-horrible-outcome ↩ ↩2

-

World Today News — MLPerfベンチマーク:https://www.world-today-news.com/deepseek-v4-on-huawei-hardware-a-new-global-ai-standard/ ↩

-

Neural Network World — ByteDance/Alibabaによる950PRテスト:https://neuralnetworkworld.com/deepseek-v4-to-run-on-huawei-chips-sidelining-nvidia/ ↩

-

NVIDIA Developer Blog — Day-0 Blackwellサポート:https://developer.nvidia.com/blog/build-with-deepseek-v4-using-nvidia-blackwell-and-gpu-accelerated-endpoints/ ↩

-

Pulse Mark — CUDAエコシステム分析:https://pulsemark.ai/deepseek-v4-release-multimodal-huawei-cuda/ ↩