2026年4月24日、DeepSeekはV4シリーズを発表した。今回、彼らが持ってきたのは単なる大きなパラメータ数ではなく、欧米のAIラボに自社の価格戦略を再考させるアーキテクチャパッケージだった。

DeepSeek V4 とは何か

1. 2つのモデル、2つのミッション

V4シリーズには2つのバリアントがある:

- V4-Pro:総パラメータ1.6兆、フォワードパスあたり490億アクティブ、フラッグシップ推論

- V4-Flash:総パラメータ2840億、フォワードパスあたり130億アクティブ、コスト最適化

両方とも100万トークンのコンテキストウィンドウをサポートし、最大384Kトークンの出力が可能。MITライセンスで公開され、重みはHuggingFaceにホストされている。

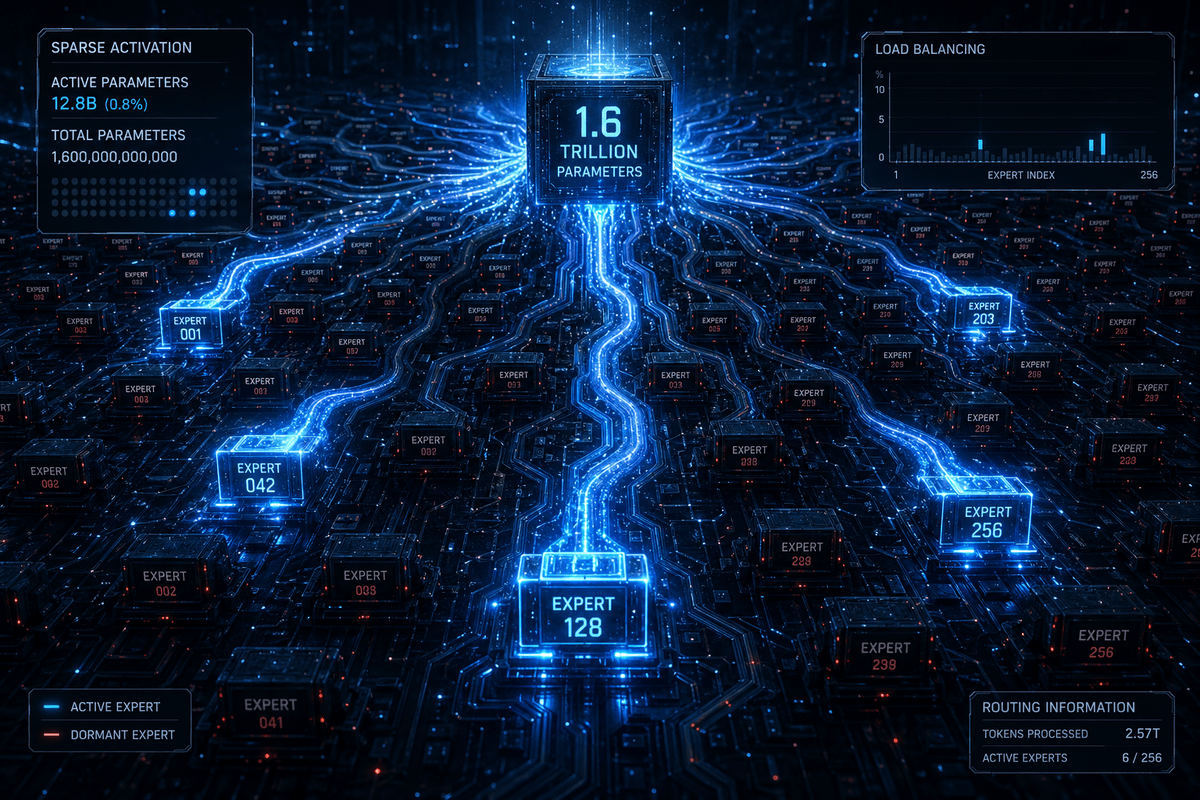

2. MoEはマーケティングではなく工学

DeepSeek V4はMixture-of-Experts (MoE) アーキテクチャを採用している。簡単に言えば:モデルは1.6兆のパラメータを持つが、各トークンは約3%(490億)のエキスパートサブネットワークのみをアクティブ化する。1000人のスペシャリストがいる会社で、各プロジェクトに最も関連性の高い30人だけを引き入れるようなものだ。

直接的な結果:推論コストは490億のdenseモデルと同等だが、能力は1.6兆のdenseモデルに迫る。 API料金は約.10-0.30/百万トークン—GPT-4の約1/50だ。

3. ハイブリッドアテンション:100万コンテキストの工学

100万トークンのコンテキストはマーケティング数字ではない。DeepSeekは2層のアテンションシステムを導入した:

- CSA (Compressed Sparse Attention):mトークンごとのKVキャッシュを単一のエントリに圧縮し、クエリトークンはtop-kの圧縮エントリのみに注目する。これにより正確な局所コンテキスト検索が実現される。

- HCA (Heavily Compressed Attention):128倍の圧縮率で積極的に圧縮し、その後圧縮表現上でdenseアテンションを実行する。これにより低コストのグローバルコンテキスト認識が可能になる。

CSAとHCAはネットワーク全体で交互に配置され、モデルは集中検索と広角認識を切り替える。100万トークン時、V4-ProはV3.2の27%のFLOPsと10%のKVキャッシュのみを必要とする。

4. デュアルモード推論:Think / Non-Think

V4はAPIレベルで2つのモードを提供する:

- Thinkモード:多段階推論、8-15秒の熟考、複雑な分析とエージェンティックワークフローに最適

- Non-Thinkモード:2秒以内のレスポンス、コンテンツ生成、要約、データ抽出に最適

これは従来の「Chain of Thought」プロンプティングよりも制御しやすい—開発者はシナリオごとに明示的に推論の深さを選択できる。

DeepSeek V4 は何ではないか

1. 単なる「GPTキラー」ではない

これを「中国のモデルがアメリカのモデルを打ち破った」に矮小化してはいけない。DeepSeekの競争優位性は、GPT-5よりベンチマークで数ポイント高いことではなく、同等の能力を1/10のコストで提供することにある。これはビジネスモデルの違いであり、純粋な技術競争ではない。

2. denseモデルの単純なスケールアップではない

1.6兆パラメータは恐ろしく聞こえるが、これは「力技で勝つ」ものではない。1.6兆のdenseモデルとして展開すれば破産する。V4の価値は、疎アクティベーション+効率的なルーティングが、能力を犠牲にすることなく、兆パラメータモデルの推論コストを許容範囲に圧縮できることを証明した点にある。

3. RAGの終焉ではない

100万トークンのコンテキストはコードベース全体や長文書を一度に飲み込めるが、それがRAGが消えることを意味しない。CSA/HCAはそれ自体が「検索強化アテンション」であり、内部でどのトークンに焦点を当てるかをルーティングする。RAGは外部検索から内部ルーティングへと移行した。形は変わったが、問題の本質は変わっていない。

4. 政府補助金の産物ではない

V4は華為昇騰チップ上で動作し、欧米の競合と比べて圧倒的に低いコストで訓練されている。これは補助金ではなく、MoEアーキテクチャ+FP8訓練+アルゴリズム-ハードウェア協調設計が計算要件を本当に削減しているからだ。DeepSeek-V3の全量訓練は278.8万H800 GPU時間のみで、不可逆的な損失スパイクやロールバックは一切なかった。

DeepSeek V4 から何を学べるか

1. アーキテクチャ革新は算力の力技より価値がある

OpenAIやGoogleがより多くのGPUを買っている間、DeepSeekは3つのことを行った:

- アテンションの最適化:長いコンテキストがもはや計算のブラックホールではなくなった

- オプティマイザの改善:AdamWからMuonに切り替え、収束を加速し兆パラメータ訓練の安定性を向上

- ルーティングの設計:モデルにどのエキスパートがどのトークンを処理するかを学習させた

これらはいずれもより多くのGPUを必要としない。より深いシステム思考を必要とする。

2. オープンソースは戦略であり、慈善ではない

MITライセンス+HuggingFace重み+最低限のAPI料金。この組み合わせは「善行」ではなく、開発者の心を急速に掌握するためのものだ。V4がデフォルト選択肢になれば、その周りにツールチェーン、クラウドサービス、エンタープライズカスタマイズがエコシステムを形成する。ここでのオープンソースは顧客獲得手段であり、最終目的ではない。

3. 「十分に良い」推論の哲学

V4-Flashはわずか130億のアクティブパラメータしかないが、ほとんどの本番シナリオで十分に対応できる。これは見過ごされがちなトレンドを明らかにする:推論コストがモデル能力を置き換え、AI製品化の最大のボトルネックになっている。 V4-FlashがGPT-4の1/50の価格で80%のタスクを完了できるとき、残りの20%の能力プレミアムは技術問題ではなく、ビジネス問題になる。

4. アテンション機構はまだ進化しうる

CSA+HCAのハイブリッド設計は、Transformerのアテンション機構がまだ枯渇していないことを示している。denseアテンション→スパースアテンション→圧縮アテンションへと、各圧縮が「アテンションは二次的複雑性でなければならない」という仮定に挑戦している。AIインフラを構築しているなら、これは深く探究に値する方向だ。

最後に

DeepSeek V4で最も恐ろしいのは、ベンチマークスコアではなく、最先端のAI能力がオープンソース+低コストで提供できるという証明だ。GPT-5が/百万トークンで価格設定するかもしれないとき、V4-Proは.30で売っている。この差は割引ではなく、構造的なものだ。

欧米のAI巨人は今、選択に直面している:閉源プレミアムルートを続けるか、オープンソース競争に値下げを強いられるか。どちらを選んでも、DeepSeek V4はすでにゲームを変えている。

参考文献:DeepSeek-V4-Pro Technical Report, HuggingFace DeepSeek-V4-Pro, DataCamp DeepSeek V4 Analysis, MorphLLM DeepSeek V4 Guide